Topics記事

2022.09.01

想像力の先の「あり得るかもしれない未来」を想像する(上)|菅野裕介

#「未然課題」連続インタビュープロジェクト #人工知能 #機械学習 #ディープラーニング #コンピューターヴィジョン #ヒューマンコンピュータインタラクション

「未然課題」連続インタビュープロジェクト

インタビュー#02 菅野 裕介

東京大学生産技術研究所 准教授|インタラクティブ視覚知能

視覚を通した人とコンピュータのコミュニケーションはどうあるべきか、機械学習やディープラーニングの学習プロセスに、人間がどのように関与していくか……。

コンピュータビジョンとヒューマンコンピュータインタラクションを研究する菅野裕介先生に、研究のクリエイティビティと閉じられた情報技術における「未然課題」、さらに現在の技術決定論な未来構想とは異なる未来についてうかがいました。

コンピューターが人間のように、画像を理解するコンピュータービジョンの技術

私は人工知能研究の一分野であるコンピュータビジョンとヒューマンコンピュータインタラクションという分野の研究に携わっています。人工知能研究はそもそも、コンピュータが人間のように知的な作業を行うこと全般を扱うため、ジャンルは多岐にわたります。このうち、コンピュータビジョンでは、コンピュータが画像を人のように認識し、理解するための技術を作っています。また、ヒューマンコンピュータインタラクションでは、人とコンピュータの相互的な作用や関わりを扱います。

人が画像から読み取ることができる情報は実に多種多様です。このため、コンピュータビジョンの研究も非常に範囲が広く、その全てを完全に分かっている人はいないのではないかと、冗談めかして言うこともあるくらいです。でも、その多様性がまた楽しいです。

私は学生時代に、視線推定の研究を始めました。視線推定というのは、人が見ている方向を予想するための技術の総称です。コンピュータビジョンの技術を使ってカメラだけから視線推定を行うための研究は古くから行われてきました。例えば福祉の分野では、視線推定を使った入力は、手が不自由な方のコミュニケーション手段として、重要なアプリケーションとなっています。

また、最も典型的なところでは、マーケティング調査での活用です。人がどこを見ているかを計測することで、目的通りの情報提示ができているか、広告の視点誘導がうまくいっているかなどを調べることができます。

さらに近年、自動運転や安全運転支援の分野でも、視線推定は非常に注目されています。特に欧州では、ドライバーのモニタリングが義務化されるため、視線推定は必須の技術となります。しかし、暗いトンネルの中から直射日光が顔に当たっている状態まで、さまざまな状況の車内で、安定して視線情報を取ることは、実はまだハードルが高いです。このため最近では、機械学習の一種であるディープラーニングを用いた視線推定が活発に研究されています。

インタビュー風景写真1.jpg)

菅野裕介氏

視覚を通した人とコンピューターのコミュニケーションの研究

このように、さまざまな目的に使用される視線推定ですが、現在、私が行っているコンピュータビジョンの研究は、視覚的に人を理解するコンピュータを作るというものです。これは単にそのようなモノを作るというのではなく、コンピュータの側から人を理解するにはどうすればよいか、視覚を通した人とコンピュータのコミュニケーションはどうあるべきかなども研究のテーマに含まれます。

視線は、コンピュータが人とコミュニケーションを取るためのモダリティの一つでもあります。人がどこを見て、何をしているかをコンピュータが理解することで、人と機械のより自然なインタラクションが実現できるのではないかと考えています。

先ほど触れたように、最近は機械学習やディープラーニングによるアプローチが盛んなのですが、対象となる人それぞれに最適化して高精度な推定を行うために、個人や環境に特化したデータを獲得するための枠組みが必要不可欠になります。視線に限らず、コンピュータビジョンのモデルがどのように対象に適応していくか、その学習プロセスに人間がどのように関与していくかも、研究テーマの一つです。

一般に、機械学習の研究というと、すでに収集された大規模なデータセットがあり、それらを使ってパフォーマンスを上げるというイメージを持たれる方が多いかもしれません。しかし、コンピュータビジョンでは、まず、画像を認識するとはどういうことか、画像や動画からコンピュータがどのような意味・情報を出力することができるか、という問題から考える必要があります。

そして、どのようにデータを収集すれば、正しく評価できるデータセットをつくることができるのか、またどのような実験をすれば、画像認識のタスクを定量的に実行できていることを示せるかなども考えなくてはなりません。そのうえで、「このようなデータセットを使って、このように問題を定式化すると、こうしたことが可能になる」という提案をすることは、研究として、とても大切なことなのです。

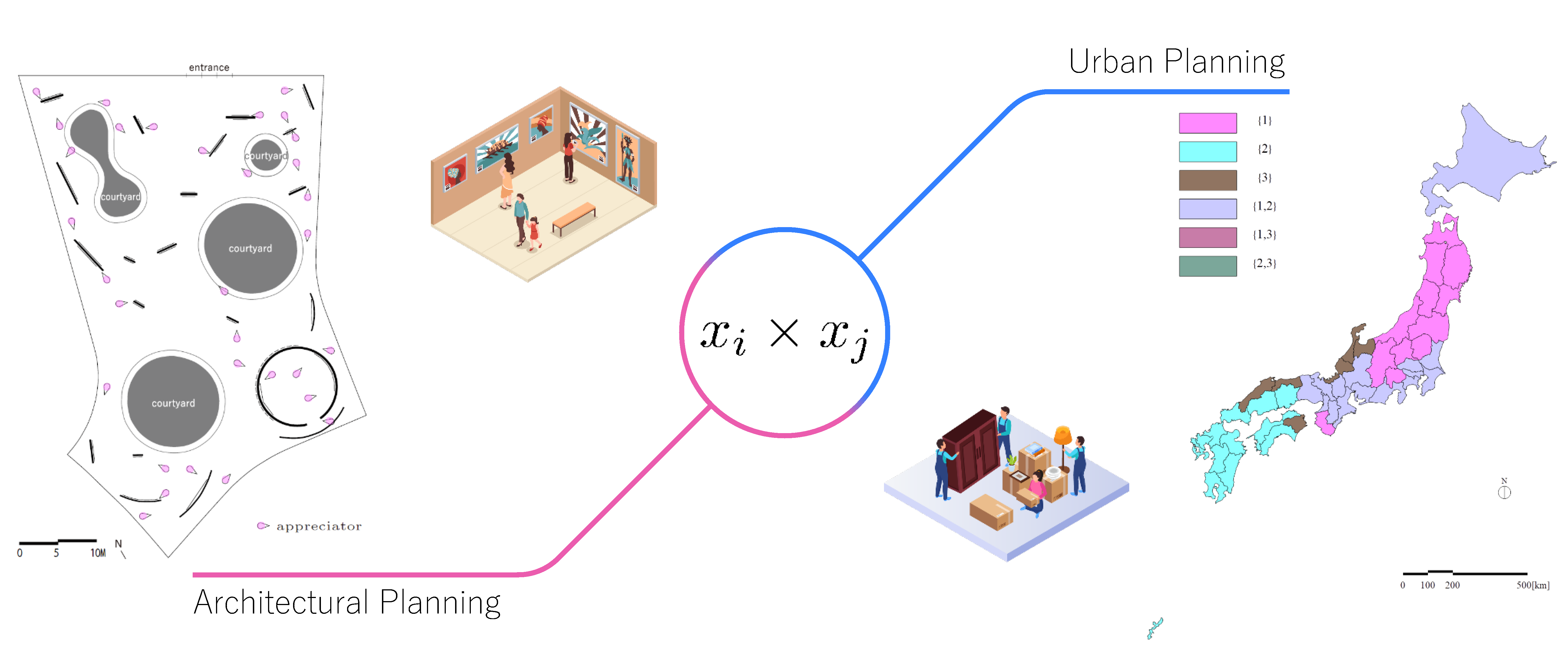

これはいわゆるAIコンサルティングのような仕事だとも言えます。今はまだ、エンジニアだけが注目される傾向にありますが、今後、こうした部分が重要になるのではないかと思っています。実際、世の中にある漠然とした問題を、どのようにしたら情報システムで解ける課題に落とすことができるかという議論は、情報工学を目指す者にとって、重要なテーマになってゆくはずです。特に、コンピュータビジョンの研究はこのような側面が顕著で、一般に思われるよりもクリエイティビティが要求される分野だと考えています。

顔を固定した視線データの収集。単調さから協力者が眠ってしまうこともあるため、ミントのアロマをたくという涙ぐましいことも

データ収集のゲーム化で、技術のブラックボックスを開く

視線推定の研究でも、人の顔や視線に関するデータをどう取得するかは、重要なポイントです。ただ、プロジェクトとしてさまざまな人の顔のデータを収集するというのは、簡単なことではありません。そもそも、顔の情報はプライバシーにかかわります。「視線のデータを取るので、顔写真を撮らせてください」と言われて、積極的に参加したいと思う人はあまりいません。

最近は、データがないときにどうするかという課題にも取り組んでいて、例えば、正面顔しかないデータから三次元復元するという研究も行っています。ただ、これにも限界があり、やはりまだまだデータが足りないという側面は否めません。

このような事情に対し、新たなプロジェクトが始まりました。それは、データ収集自体をゲームにするというもので、生産技術研究所のDLXデザインラボと共同研究を行っています。

デザインラボではもともと、研究テーマの一つとして、地域とのサイエンスコミュニケーションをどのように行うかという課題に取り組んでいました。そこで、地域住民の研究参加を通じてコミュニケーションを取る機械を設計できないかという話になったのです。

私たちとしても、楽しくデータセットの収集に参加していただければ、自分の顔写真が研究に使われることを、ポジティブな方向で考えてもらえるのではないかと思いました。また、プライバシー懸念のあるブラックボックス的な技術として捉えられがちな視点推定についても、批判を含め、もう少し建設的なディスカッションをすることができるかもしれません。

こうした経緯から、ゲーム形式でデータ収集する「AICOMプロジェクト」がスタートしました。基本的に、二人一組で行う協力のゲームとなっていて、交互に出題側と回答側をやりながら、なるべく相手に正確に視線方向を伝え、ペアとしてのスコアを上げていきます。

まず、一方のプレイヤーが出題者となり、システムが提示する単語の文字を相手のプレイヤーに視線で伝えます。回答者には問題単語の一部のみ最初から提示されていて、透明の文字盤越しに出題者の視線を読み取りながら空欄の文字を推測し、出題された単語を当てるという流れです。

先日、生産技術研究所の公開ワークショップで、このゲームを行ったときは、コロナ禍ということもあり、知らない者同士が透明板を挟んで、目線でコミュニケーションを取るという体験自体が、意外に面白いという副産物もありました。

さらに次の段階として、視線推定のモジュールを組み込み、AIが第三者として回答に参加するという仕組みも作ろうとしています。それにより、参加者はAIが人間と同じように徐々に上達してくるという過程を体験できますし、これまでブラックボックスだった機械学習についても、技術理解を深めることができるという複合的な意味があります。

このようにデータ収集をゲーム化するというコンセプト自体、実はいろいろな機械学習の応用研究に使える可能性があるのではないかとも思っていて、視線推定以外のタスクでも、ゲームを通してデータ収集するということを考えているところです。

新たに開発したゲーム形式で視線データ収集する「AICOM」の参加型ワークショップ。協力者にも楽しんでもらえる

多様な人の研究参加から見つかる新たなテーマ

また、ユーザー独自の視点を元にコンピュータビジョンや機械学習応用の問題を設定・設計する過程を補助・一般化する方法も研究しています。世界に存在する課題をどのように機械学習の問題として定式化するかというプロセスは具体的な研究開発を行う上で一番のポイントで、現状のやり方ではその過程でこぼれ落ちてしまう課題もあるはずです。

例えば、障害者支援のプロジェクトで、視覚障害があるユーザーを助けるためのコンピュータビジョンモデルを、視覚障害のない研究者が作ってよいのかという問題があります。現状では一般論として、研究者の側が「この物体とこの物体は重要であるはずなので、検出するべきだ」と考え、データセットを作っています。しかしそれらは当然、当事者の意見とは異なる可能性も高いです。

もちろん、視覚障害のある方固有のデータを集めるしくみなどの研究事例はありますが、方法論として一般化するためには未解決の課題も多いです。また、こうした問題はアクセシビリティの問題だけに留まらず、研究者だけで考えるより、もっと開かれた議論を行うことで、新しい研究課題が見つかるかもしれません。

そのためには、データセットを作ることや問題を定義するところ、つまり研究のクリエイティビティが要求される部分を、どのように研究コミュニティの外に開くかということは、非常に重要な課題だと考えています。

そのアプローチの一環として、初心者ユーザーが自分なりの機械学習のモデルを作れるようなグラフィカルなインタフェースの研究も行っています。その一つが、音を使ったインタラクティブな機械学習です。本来、コンピュータが音を聞き分けるというのは、それほど簡単なことではないのですが、事前に大量の音データから特徴表現を学習したモデルを使うことで少しのデータでも効率よく学習できるようにしています。

システムではこの特徴表現を可視化した地図の中から音を探せるようになっていて、ユーザーが新しく音を録音すると、特徴表現の類似度を元にその音もこの地図上にマッピングされるようになっています。機械学習を体験するためのシステムはどうしても中身がブラックボックスになりがちなのですが、私たちのシステムでは中身の仕組みを可視化することで、機械学習がどのように行われているのかを学ぶきっかけになることを期待しています。

このシステムを使ったワークショップに、ろうの子供たちが参加してくれたことがあるのですが、「見た目が似ている楽器の音がどれだけ違うのか」など、特徴地図の機能を使って音そのものの特性を調べる方向に彼らの興味が発展していてとても面白いと思いました。

それは、データの検索や中身の解釈という私たちが想定していた使い方とは異なるのですが、「音というのはどういうものか」「自分がAIを使えるとしたら、これまでできないと思っていたこともできるのではないか」など、子どもたちとディスカッションすることができ、私たちにとっても貴重な経験となりました。

ですから、機械学習をブラックボックスとして扱わずに、いろいろな方と一緒に考えてみると、新しい研究テーマや課題が見えてくるのではないかと感じています。

音を使ったインタラクティブな機械学習で作成された音の特徴地図

関連サイト:菅野研究室|https://ivi.iis.u-tokyo.ac.jp/

(2022年7月11日 東京大学生産技術研究所 菅野研究室において 取材・構成:田中奈美)

#「未然課題」連続インタビュープロジェクト #人工知能 #機械学習 #ディープラーニング #コンピューターヴィジョン #ヒューマンコンピュータインタラクション